What is LLL

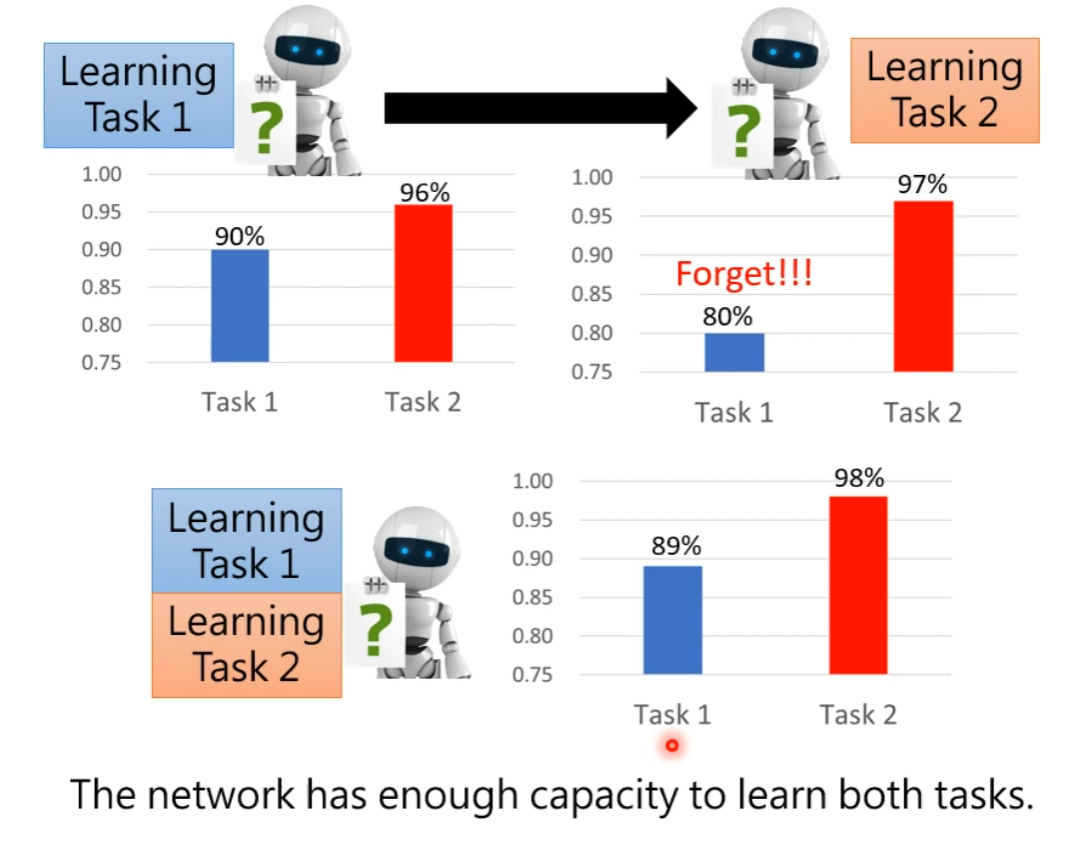

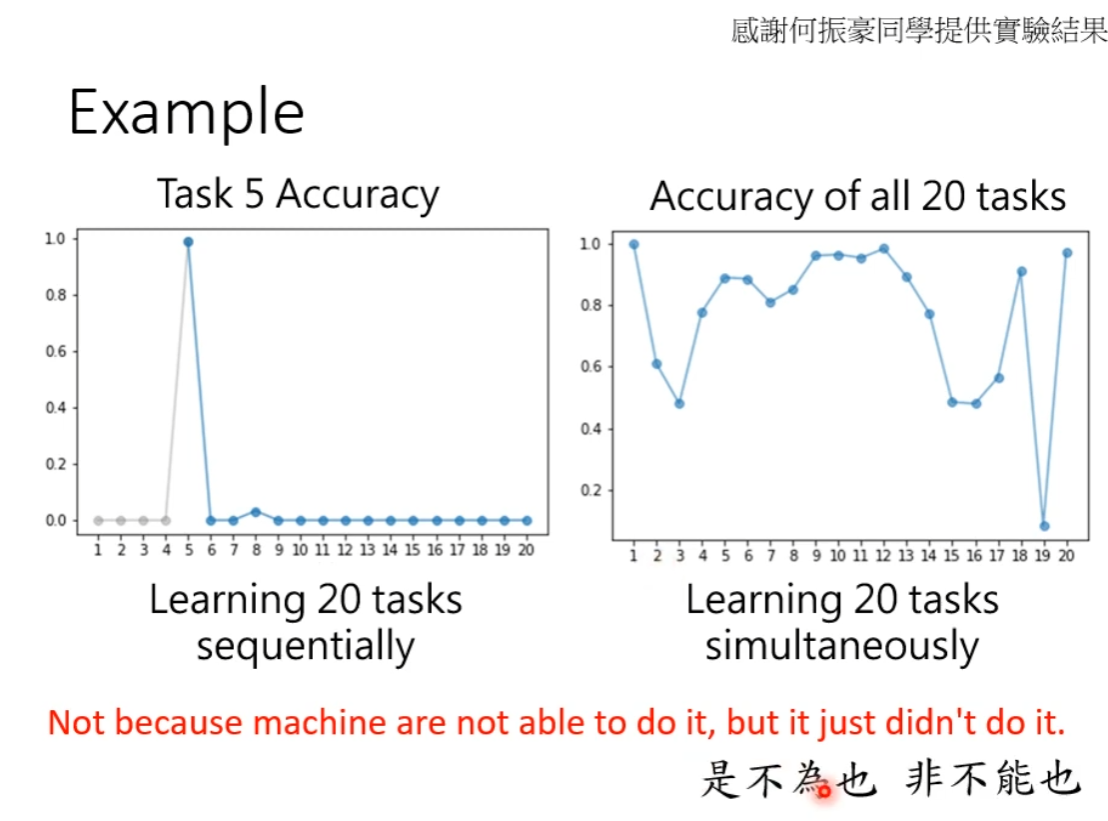

Catastrophic Forgetting

一个模型,有能力学好两个任务。但是如果依次学习的话就会忘掉之前学的。

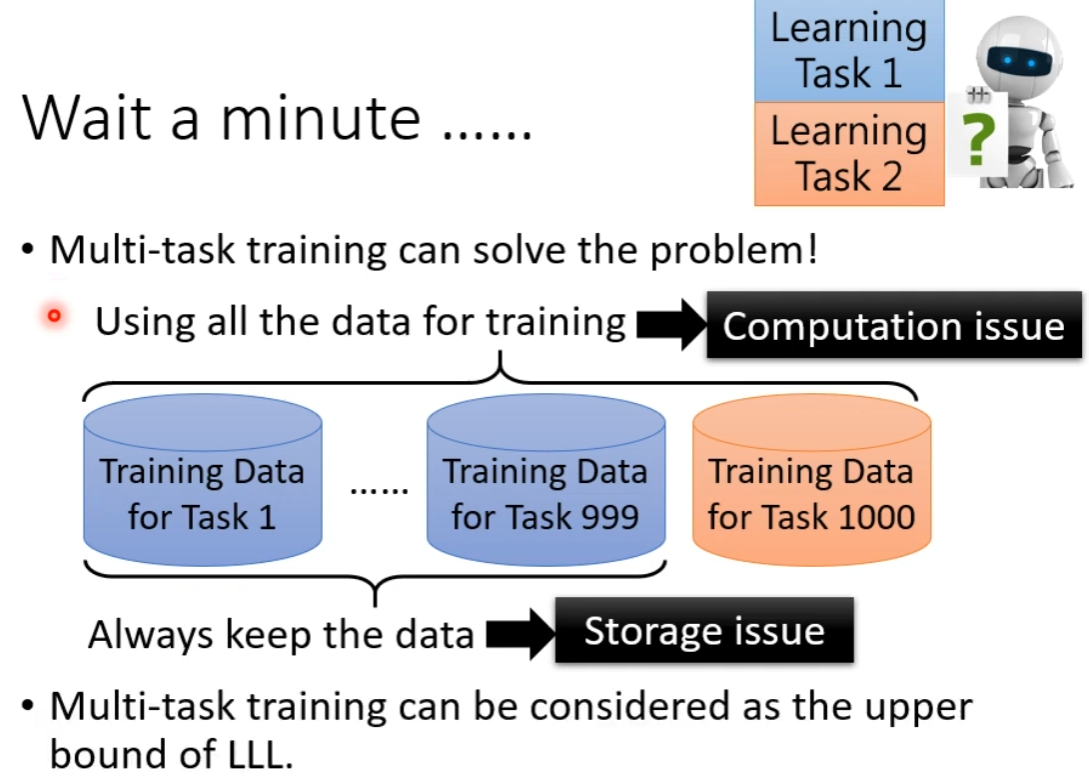

Specious Remedy

- Multi-task training:

但 Multi-task training 一般是作为 LLL 的上限,用于评估的。

- Train a model for each task:

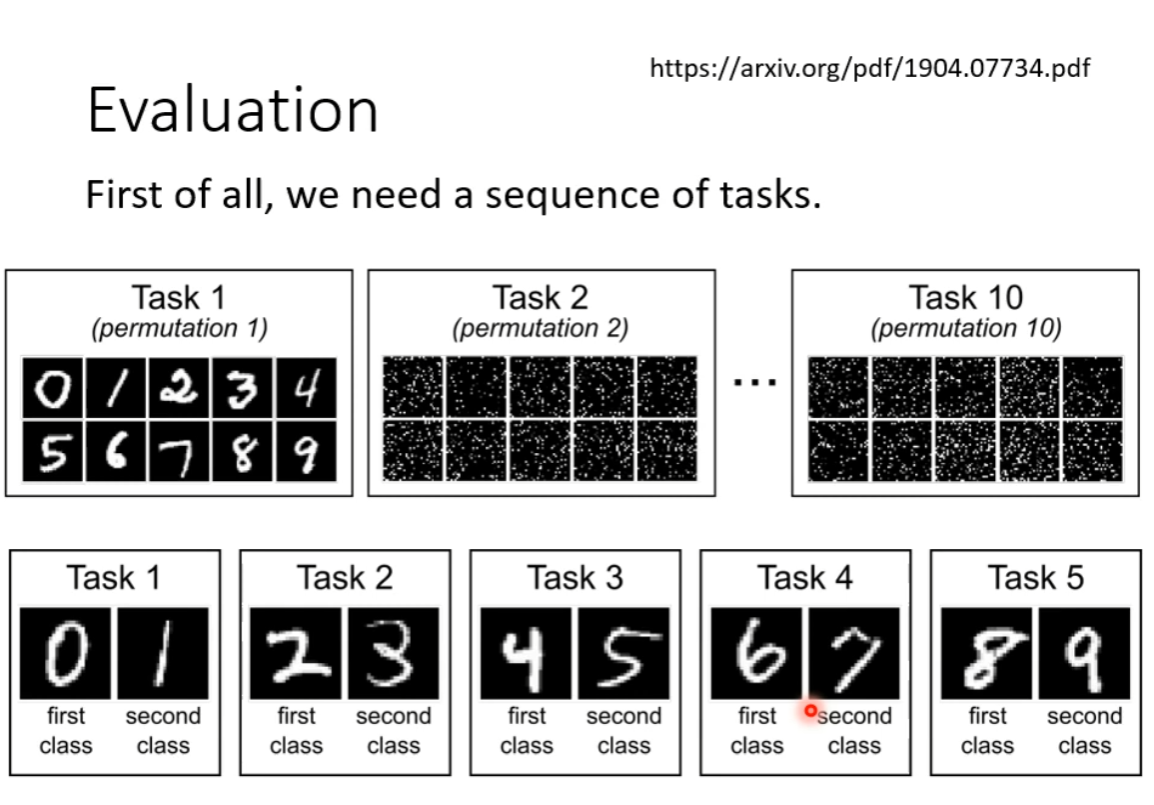

Evaluation

三个指标:Accuracy,Backward Transfer,Forward Transfer

Research Direction

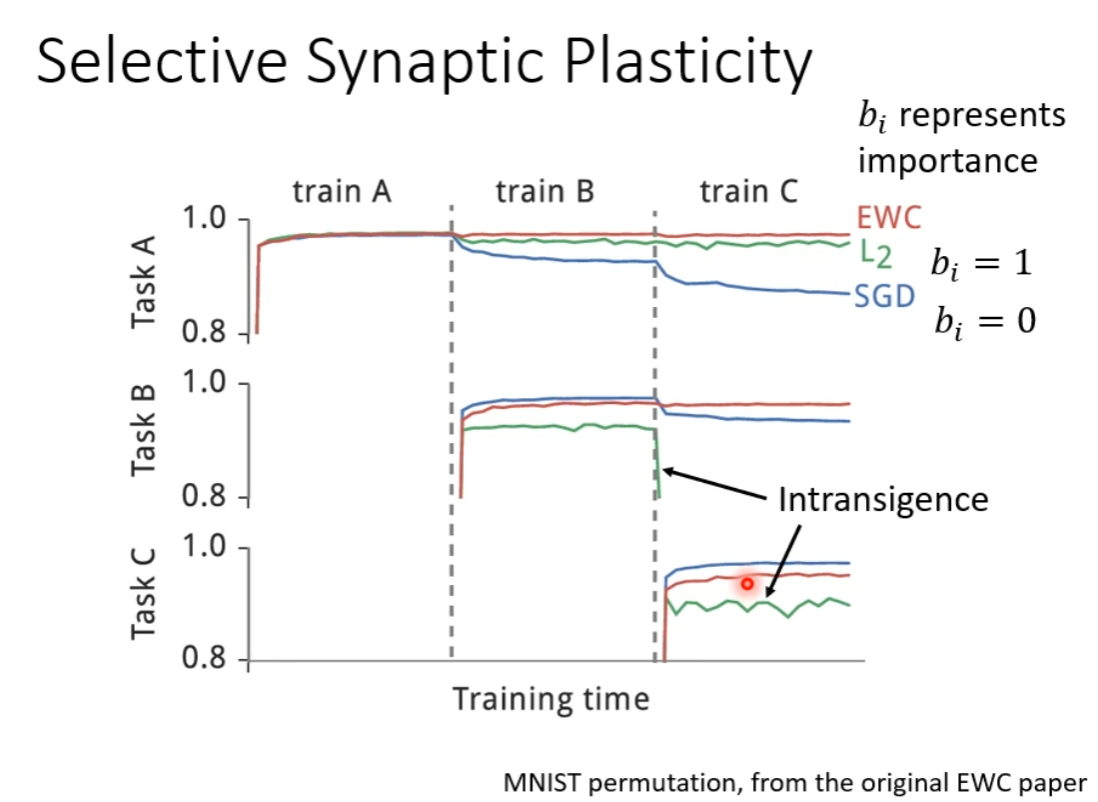

Selective Synaptic Plasticity

选择性突触可塑性,也就是只有一部分的神经元可以在后续被改变。是一种 Regularization-based approach

Why Catastrophic Forgetting?

两个任务的 Error Surface 不同,随着先后学习不同任务,导致模型参数移动出了以前的任务的低 Loss 区域。

Solution

其中 是非常关键的,象征某个参数对以往任务的重要性,是 hyperparameter。各种研究也集中于如何设定

我们主要改变对前面任务影响不大的参数,从而做到不忘记前面的任务。

Example

Papers

主要是专注于 的计算

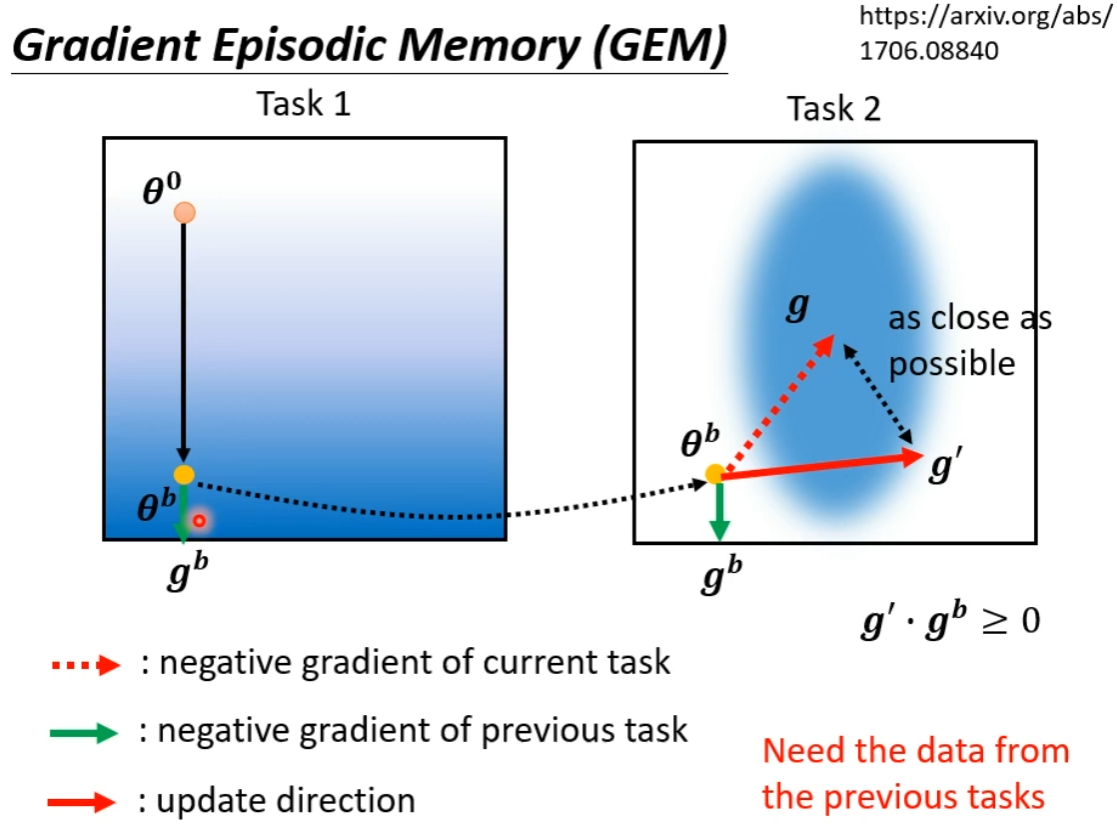

GEM

需要存一点点过去任务的资料

Additional Neural Resource Allocation

一直给模型做加法。训练一个任务后,原有的参数不再动了,随后新开一些 network,接收新的任务的输入和原来任务的隐藏层输出,从而既做到不遗忘以往任务,又可以做到信息互通,占用量也比多个模型小得多。

但是还是面临着随着任务量增大而占用增大的情况

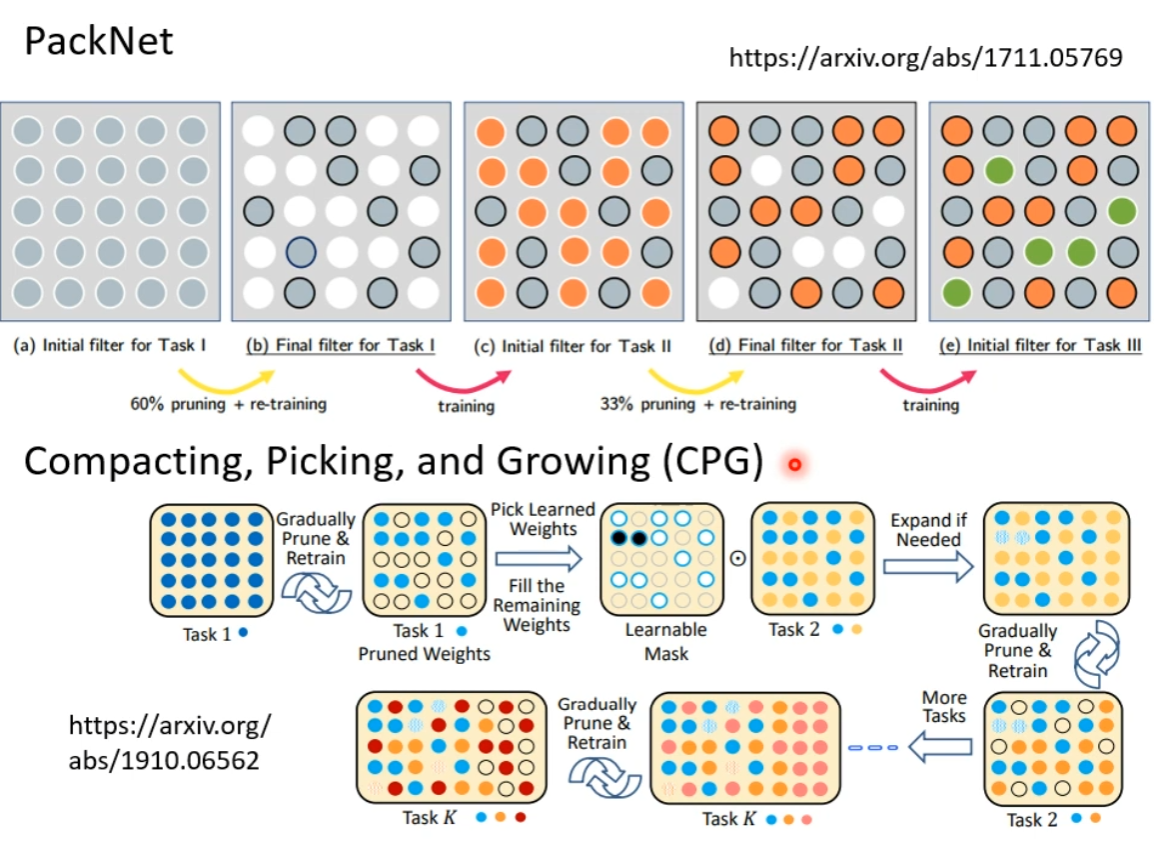

还有 PackNet、CPG

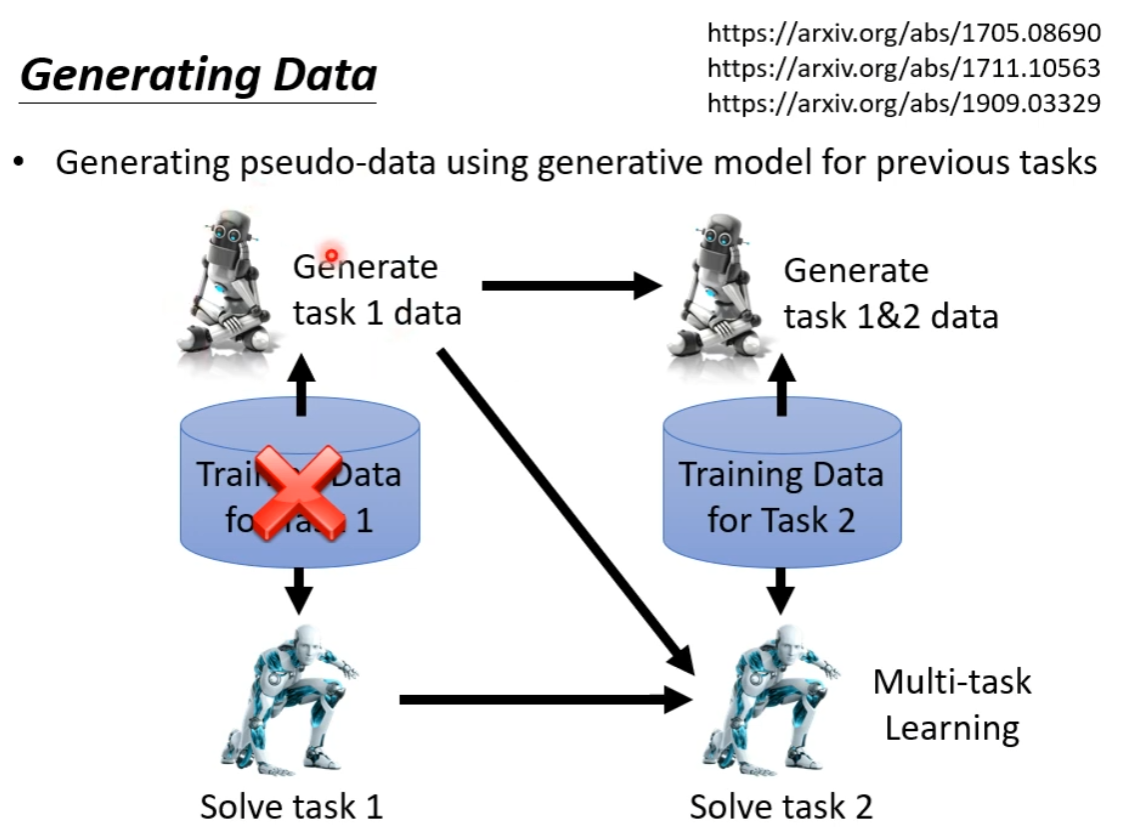

Memory Reply

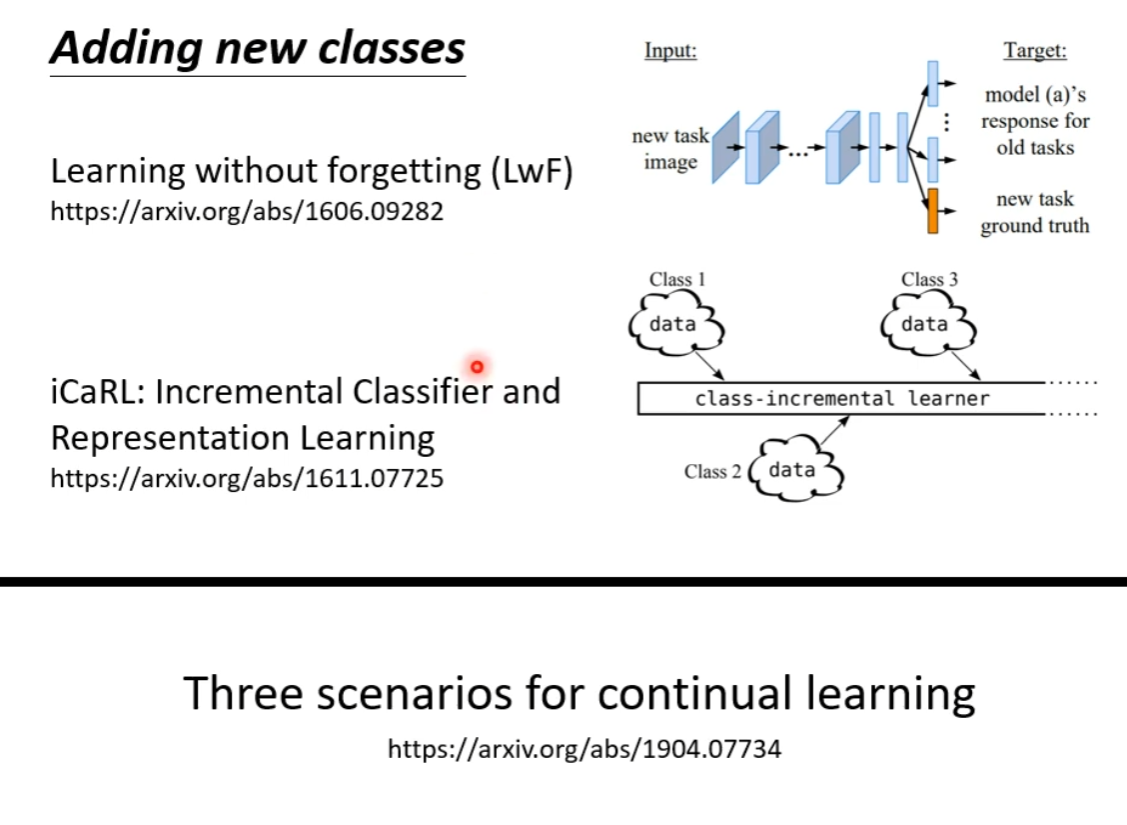

Adding New Class

刚刚我们都假设我们的模型在不同任务需要输出的类别数是一样的,但现实并不总是如此,所以也有增加类别的研究。

Curriculum Learning

任务的顺序也是有很大影响的。什么样的顺序是好的,有 Curriculum Learning 这一领域研究。